Opera浏览器将提供从数十个AI中进行选择的选项

Opera是一家以同名网络浏览器而闻名的挪威软件公司,几天前宣布,它将在其浏览器Opera One中添加对来自约 50 个模型系列的 150 种本地大语言模型 (LLM) 变体的实验性支持。

本地法学硕士允许用户直接从计算机访问人工智能模型,而无需离开设备进行处理。这意味着延迟较低,因为所使用的数据不是通过互联网发送的。由于它们不需要互联网连接,这也意味着它们不能用于训练其他语言模型。

正如该公司在新闻稿中所解释的那样,这项新功能是AI Feature Dropsde Opera计划的一部分,并且可以作为Opera 浏览器开发人员渠道的一部分进行访问。感兴趣的用户需要更新到最新版本的Opera Developer才能访问本地法学硕士。

Opera 浏览器和游戏执行副总裁Krystian Kolondra表示:“以这种方式引入本地法学硕士,使 Opera 能够开始探索在本地人工智能新兴领域创造经验和知识的方法。”

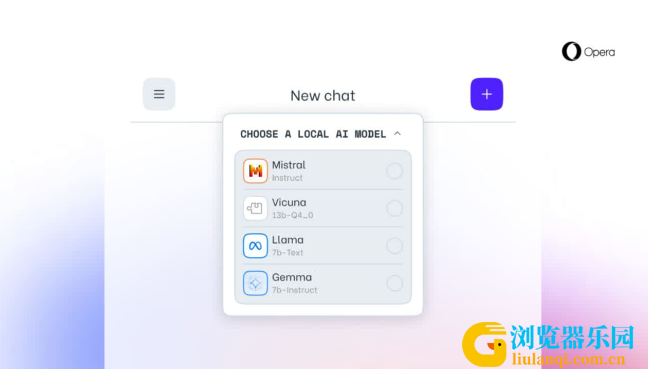

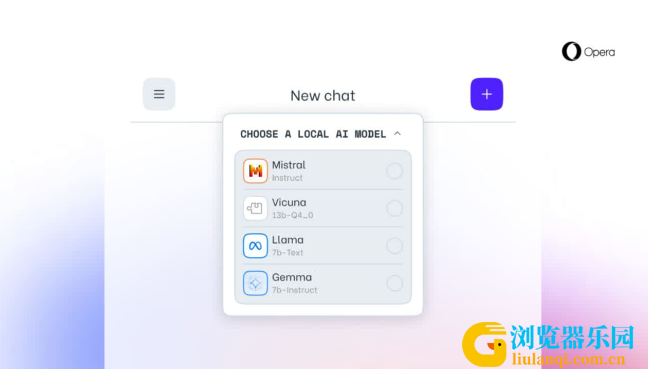

与 Opera One 兼容的本地模型包括Meta 的Llama、Google 的Gemma 、Mistral AI 的Mixtral和Vicuna。大多数本地 LLM 每个变体需要2 到 10 GB 的本地存储空间,并取代Opera 浏览器的原生 AI Aria 。

要下载并激活其中一个新变体,用户必须打开 Aria 聊天,从下拉菜单中选择“本地模式”,然后从设置中选择要下载的模型。从那里,可以下载并激活多个模型。